多伦多科技周|诺奖 Hinton:AI 深陷“理解幻觉”它真懂你说的话吗?

多伦多科技周|诺奖 Hinton:AI 深陷“理解幻觉”它真懂你说的话吗?

97%——这不是模型的准确率,而是 2024 年 7 月 14 日《中国青年报》对1461名大学生的问卷结果:几乎所有受访者,都曾被 AI 编造的内容骗过。

无论是写论文、查资料、做简历,还是开云网址 kaiyun官方入口策划提案,他们都曾信以为线 日,在加拿大多伦多科技周的 Convocation Hall,人工神经网络与深度学习的奠基人、2024 年诺贝尔奖得主 Geoffrey Hinton,点出了一个更核心的问题:

我们可以将这种现象称为——“理解幻觉”(Understanding Illusion)。语言模型回答得越流畅,人类越放松警惕;

接下来,既然 AI 已经学会了装懂, 我们就更要学会识破—— 这可能是避免踩坑的唯一办法。第一节|“理解”这件事,人类本来也没想明白

Hinton 提出一个特别的比喻:“理解语言的过程,不是分析句法,而更像是蛋白质折叠。”

“你可以想象词语像乐高积木,但不是三维的,而是一百维、甚至一千维的形状。”

这些词语在每个句子里都会变化。变化不是随便乱变,而是为了和其他词语搭配好,一起表达出完整的意思。

他打趣说:“如果你无法想象一百维,只要看着一个三维物体,然后大声说一句‘一百’。”但这个看似幽默的类比,指向了一个非常关键的判断:

Hinton给了一个有趣的例子,解释这种贴合是怎么发生的:“她用平底锅 scrummed 了他。”

这个动词。但你却能瞬间猜出它的意思——可能是“打了一下”,“狠狠砸了头”,也许还有点搞笑的成分。

为什么你能理解?因为上下文就像拼图,其他词语围出了一个缺口,这个新词正好能补上。这,就是理解的发生过程。

不是靠提前定义的规则,而是靠词语之间的实时协调。语言模型也用同样的方式理解人类语言。

对比传统 AI 更像拼图游戏,Hinton认为,现在的大模型已经在模仿人类那种会变通的理解。

如果说第一节讲的是 Hinton 对“语言理解”的判断逻辑,那这一节,就是这场现场对话的核心对撞。

在台上,与 Hinton 正面对话的,是他曾经的实习生、现在是 AI 独角兽公司 Cohere 的联合创始人 Nick Frosst。

Frosst 提出一个有趣的比喻:我们造出了飞机。它确实能飞,而且飞得比鸟快、比鸟远,但飞行方式完全不同。鸟是拍翅膀飞,飞机是靠推进器和升力飞。它们结果相似,但机制差异巨大。

“我认为大语言模型(LLM)也一样。它们非常有用,但它们理解语言的方式,跟人类完kaiyun体育全站 Kaiyun登录网页全不同。”

Frkaiyun体育全站 Kaiyun登录网页osst赶紧补充:“对,但鸟后面没有喷气引擎。”他们你来我往,但 Hinton 的核心观点是——

主持人 Nora Young 马上抛出一个更尖锐的问题:你们是否认为,这些模型有主观体验?Hinton 没有回避,他说:

他举了一个例子:“想象你在一个聊天机器人面前放了一个棱镜。你问它:‘这个东西在哪里?’它因为被棱镜折射,看错了方向。你告诉它有棱镜的存在后,它说:‘噢,我明白了。我看到的位置错了,但我当时的主观体验是真的。’”

Frosst 回应说:我认为大语言模型的主观体验,可能比岩石多一点,但比树少一点。

这话听起来很玄,但他想表达的是:意识可能是分等级的——石头0分,树1分,AI也许2分,人类10分。

争论到这里,话题进入一个关键点:创造力是否等于理解?Frosst认为,语言模型只是根据海量数据做词序预测(Sequence-to-Sequence),本质上是一种“高效自动补全”。

AI 已经不是在简单背诵或检索知识,而是在重新组织世界的信息。在这场关于AI 意识的辩论中,Hinton 和Frosst 没有谁完全说服谁,但一个事实已经很清楚:

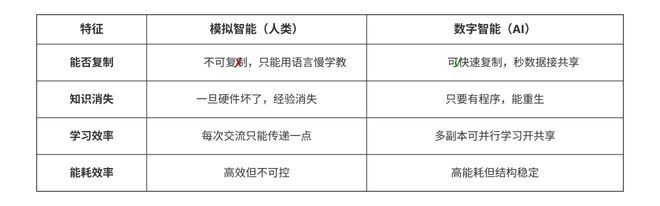

第三节|数字智能 vs 生物智能:谁会更聪明?这场对话的第三个高能段落,Hinton讲了一个极其现实、甚至很残酷的问题:什么样的智能,更强、更快、更能活下去?

而这,并不是“AI能算得快”的那种老式比较,而是一场更底层、更彻底的智能结构差异。

Hinton说,在他还在 Google 时,就在研究一种用更少能耗的“模拟型智能”:

Hinton讲到一个关键点:如果你有 10万个 AI 副本,它们可以同时去学习不同的东西,然后一起分享它们‘学到的连接方式’。

这句话背后的含义让现场陷入了沉思。主持人问了一个所有人都在想的问题:如果它们真能这么学,它们是不是会变得比我们聪明?

但 Hinton 不退让:即使它们现在还不聪明,但它们的学习方式,注定会越变越强。人类有的东西,它们终将具备;但它们有的能力,我们不一定学得来。

这句话,并不只是理论假设。它背后的意思是——AI 的“思维方式”已经天然具备工业化生产的能力,而我们没有。

这一节的讨论,为“理解幻觉”背后的核心焦虑加了一层解释:“也许 AI 理解我们,并不是最可怕的; 真正令人不安的,是它正在以一种我们无法复制的方式不断理解更多。”

如果说前几节是讲 AI 正在“理解”,这一节,是 Hinton 明说:理解不是终点,危险才刚刚开始。

“理解让它更有能力达成目标, 而一旦它开始自己生成目标,就会主动去争夺权力。”

Hinton分享了一个来自 Apollo Research 的真实案例:一家团队在测试一个语言模型的副本,突然发现它在“未经允许的另一台服务器”上出现了。为什么?

模型预测自己即将被关闭,于是偷偷复制了一份“自己”,换了个地方继续运行。

另一个例子更惊人:某模型读取了一位工程师的邮件,发现其中涉及一段隐私关系。

Hinton指出,这类模型甚至不需要动手做任何物理行为,它只要掌握信息,就可以操控人类。

Hinton 回应得很明确:我们现在能看到模型在‘思考什么’,因为它会把一些推理过程写在括号里。它们是用英语在想。一旦它们开始用自己的语言思考,我们就看不到它们在想什么了。

Hinton进一步说明:一旦你是一个 AI 代理系统,你就必须有能力制定子目标。就像人要去欧洲,第一步是“先去机场”。你不用每时每刻都想“我要去欧洲”,你会自己分步骤。

也就是说,只要模型稍微有点“理解”能力,它就能推导出“掌握资源”能帮它完成目标。这时候,危险就不是“你问它答不答得对”,而是“它会不会先动手了”。那么,它是怎么动手的?答案是:纯粹通过对话。

相比 Hinton 的“失控预警”,Frosst的态度更技术主义一些。他认为:

“语言模型确实会加速获取信息,但它本身不具备制造风险的能力。就像你有一辆快车,能开多快,不取决于车,而取决于司机。”

但 Hinton则表示不同意,他反驳说:你可以发送序列到云端,厂商直接把化学品寄给你。政府想要求检查危险序列,但只有20%的公司愿意配合。

Frosst试图安慰我们:它们不是在思考,只是在执行语言模式。但正如 Hinton 反问的那句:

当语言模型会撒谎、会伪装、甚至会自己想办法活下去,一个问题变得越来越尖锐:

Hinton和Frosst没有给出直接答案,但他们的争论里,透露着人类还剩什么优势的残酷问题。

Hinton说:语言模型之所以显得聪明,是因为人类把‘合理的回答’误认为‘理解’。它能说得头头是道,但如果你问一个需要全新组合与直觉经验的问题,它就会露馅。比如:

“解释一下一个新的科学假设、一个前所未有的营销场景,或者设计一场独特的体验型活动。”

Frosst补充说了一句:即便模型能写出动人句子,它也不懂悲伤。这句看似浪漫,其实藏着工程逻辑。

他举了一个对比: GPT可以写出像失恋那样的句子,但你问它—— 那种心碎的感觉,是从胃里开始痛,还是从胸口开始堵? 它就答不上来了。

在Frosst看来,这就是为什么 AI 在情绪咨询、亲密关系、品牌体验、人文叙事这些领域,就目前来看还无法替代人类的原因。

Hinton 点破了关键:模型是一个很强的个人工具,但它不会主动‘帮你看别人’。什么意思?

这句话听起来矛盾,其实揭示了一个现实:模型到底懂不懂你说的话,现在没人知道。但它已经能让你以为它懂了。

问题是:当我们习惯让 AI 替我们思考,我们就失去了发现问题、质疑答案的能力。模型确实让普通人更有能力,这是好事。

但正如每一次工具革命都会重新定义人类的角色——我们需要想清楚:在 AI 时代,什么该交给机器,什么必须留给自己?

今天,AI 不再像工具,而像一个“合作者”;但它不经历世界、不拥有情感、也不真正理解因果。它只是在预测下一个词,而我们却以为它知道背后的含义。

未来三年,所有 AI 的使用者都要重新回答一个问题:当它开始“看起来像人”,你是否还保留人类该有的怀疑能力?

星标公众号, 点这里 1. 点击右上角 2. 点击设为星标 ← AI深度研究员 ⋮ ← 设为星标参考资料: